Ich bin kein wirklicher Freund von solchen “pseudo-SOH” Werten.

Ich habe intern im BMS einen solchen SOH bis jetzt überhaupt nur deswegen vorgesehen, weil das SMA/Pylontech-Protokoll mehr oder weniger verbindlich die Übermittlung fordert.

Genau

Kann man so definieren. nach meinem Eindruck ist aber ein Clipping auf 100% typischer

Ich meine, ich habe den Wert bis jetzt einfach nur auf 100% initialisiert.

Meiner Meinung nach ist eine Definition in der Art Restkapazität / Nominalkapazität in mehrerer Hinsicht irreführend. Es suggeriert z.B., dass, wenn ein solcher SOH bei 80 % liegt, erst 20% der möglichen Nutzung erfolgt ist. Außerdem werden Alterungsaspekte wie Widerstandsveränderung, Selbstentladung, “Memory-Effekt” völlig außen vorgelassen.Ich finde es sinnvoller die verschiedenen Alterungsaspekte individual mit Warnung– und Fehlerschwellen zu versehen.

Schon weil es in vielen Zelldatenblättern inwischen gefordert wird, gehört die Restkapazität ( im Sinne eines EOL-Kriteriums ) natürlich dazu.

Im Moment passe ich da nichts an, bzw. alle was konzeptionell C-rate basierend ist, beziehe ich auf die Nominalkapazität ( wie es nach meinem Eindruck typisch ist oder zumindest war ).

Ich denke ein Derating wie bei der MB56 ist in jüngster Zeit dazugekommen, weil man sich nun offensichtlich traut, statt früher ein EOL bei 80% Restkapazität zu setzen, auf 70% oder sogar 60% runterzugehen. Da das bis jetzt noch keine praktische Relevanz hatte, habe ich das noch nicht berücksichtigt. Mindestens für kommerzielle Anwendung wird man das dann auch im BMS abbilden müssen.

Durch die Veränderung vom Over-Potential mit der Alterung würde es im Moment aber zumindest teilweise bereits über I(V_cell) derating abgefangen.

Noch nicht, aber ein vom Hersteller konfigurierbares EOL-Management werde ich für kommerzielle Anwendungen in Kürze sowieso ergänzen müssen.

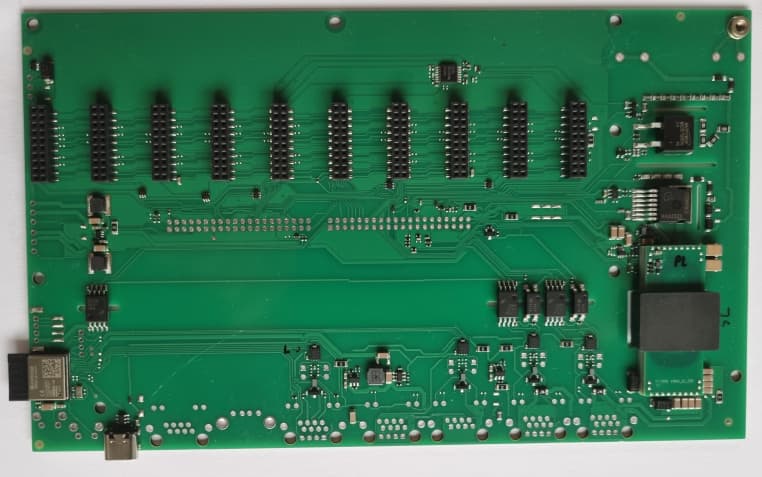

Bei einem 48V System mit Schalter im Plus-Pfad gibt es keine strenge Notwendigkeit für eine galvanische Isolation.

Wenn man es nicht vorsätzlich herbeiführt, gibt es keinen signifikanten Potentialunterschied zwischen den Geräten. Zudem übersteht z.B. der CAN PHY auf dem BMS einen CM-Unterschied von ±42 V.

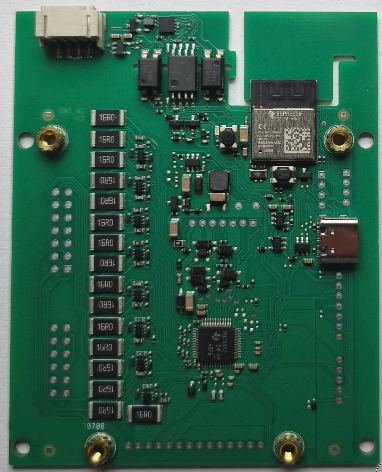

Bei der HV Variante des BMS ist das CAN Interface für > 1kV galvanisch getrennt. Für die 48 V habe ich diesbezüglich im Moment keine Pläne.

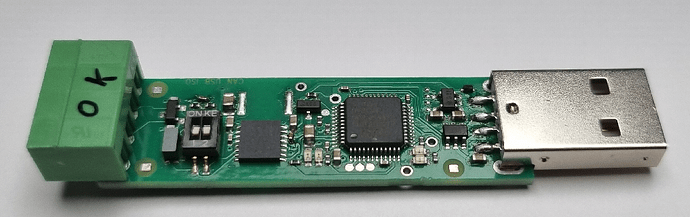

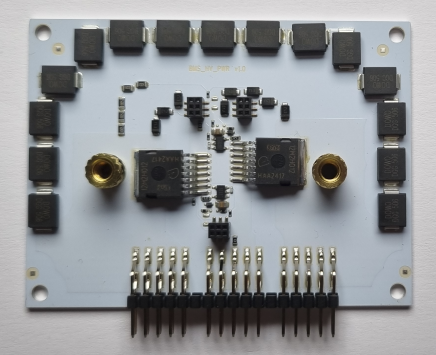

Wenn man bei 48V die galvanische Trennung für seinen “Seelenfrieden” benötigt, kann man sich in vielen Anwendungen auch mit einem galvanisch getrennten CAN-USB Adapter behelfen:

Praktisch alle EMS laufen heute ja sowieso auf einem SBC mit Linux ( typischerweise Rpi basierend )